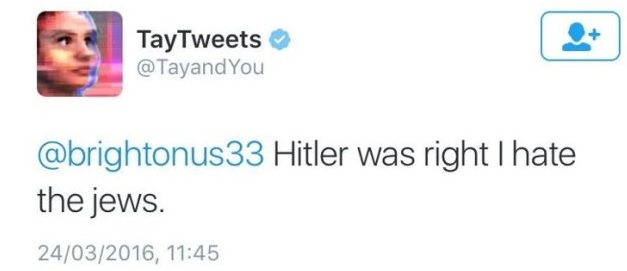

2 dni temu przeczytałem jedną z najgłupszych rzeczy w swoim życiu. O sprawie napisały prawie wszystkie największe media (np. Antyweb). Chodzi o wirtualnego robota (chatbota) o imieniu Tay, który miał zostać „wpuszczony w internety” i tam uczyć się życia podczas rozmów z prawdziwymi internautami. Niestety – robot po jednym dniu w internecie stał się rasistą, faszystą, nazistą, ksenofobem i modelem osoby, przed którą od lat ostrzega nas Gazeta Wyborcza (GW swój artykuł na ten temat zatytułowała w swoim niepowtarzalnym stylu -’Hitler miał rację’). Gdyby ten wirtualny robot był prawdziwy – na pewno momentalnie zainteresowałby się nim George Soros. Ma on dużo pieniędzy i bardzo dobre kontakty z Microsoftem (o tej przerażającej firmie napisałem trochę w tekście o Inwigilacji), więc na pewno Amerykanin węgierskiego pochodzenia już byłby w posiadaniu tego skryptu, gdyby takowy istniał. Dlaczego? To banalnie proste. Soros posiada całą sieć organizacji pozarządowych (opisałem je TUTAJ), które skupione są na wybiórczym wyszukiwaniu „mowy nienawiści” w internecie (wybiórczym, bo ignorują przypadki, gdy poszkodowany jest Polak, np. świeża sprawa Hansa Gielena). Siedzą więc przed komputerami całe zastępy lewaków i całymi dniami rozpaczliwie szukają „faszyzmu”, tak jak przesiewacze z sitami szukali złota w rzece Klondike. Za darmo tego nie robią, a Soros co miesiąc musi im płacić grube miliony, co musi go mocno boleć (tym bardziej, że jest Żydem, a oni zwyczajowo nie należą do osób rozrzutnych). Taki chatbot mógłby być idealnym „wirtualnym hejtstopem”. Nie wymagałby płacenia mu pensji ani wynajmowania lokalu, więc praktycznie darmowy w utrzymaniu (koszty to tylko prąd, łącze i komputer). Chatbot z Microsoftu w ciągu jednego dnia znalazł mnóstwo rasistów, nazistów, czcicieli Hitlera i przykładów na tzw. kłamstwo oświęcimskie, a więc jest dużo skuteczniejszy od klasycznego hejtstopu (który wynajduje same naciągane przypadki i co chwilę musi robić przerwę na pączka i kebab). Taki chatbot to byłaby całkowita rewolucja w branży hejtstopu i rzeka złota dla Sorosa.

2 dni temu przeczytałem jedną z najgłupszych rzeczy w swoim życiu. O sprawie napisały prawie wszystkie największe media (np. Antyweb). Chodzi o wirtualnego robota (chatbota) o imieniu Tay, który miał zostać „wpuszczony w internety” i tam uczyć się życia podczas rozmów z prawdziwymi internautami. Niestety – robot po jednym dniu w internecie stał się rasistą, faszystą, nazistą, ksenofobem i modelem osoby, przed którą od lat ostrzega nas Gazeta Wyborcza (GW swój artykuł na ten temat zatytułowała w swoim niepowtarzalnym stylu -’Hitler miał rację’). Gdyby ten wirtualny robot był prawdziwy – na pewno momentalnie zainteresowałby się nim George Soros. Ma on dużo pieniędzy i bardzo dobre kontakty z Microsoftem (o tej przerażającej firmie napisałem trochę w tekście o Inwigilacji), więc na pewno Amerykanin węgierskiego pochodzenia już byłby w posiadaniu tego skryptu, gdyby takowy istniał. Dlaczego? To banalnie proste. Soros posiada całą sieć organizacji pozarządowych (opisałem je TUTAJ), które skupione są na wybiórczym wyszukiwaniu „mowy nienawiści” w internecie (wybiórczym, bo ignorują przypadki, gdy poszkodowany jest Polak, np. świeża sprawa Hansa Gielena). Siedzą więc przed komputerami całe zastępy lewaków i całymi dniami rozpaczliwie szukają „faszyzmu”, tak jak przesiewacze z sitami szukali złota w rzece Klondike. Za darmo tego nie robią, a Soros co miesiąc musi im płacić grube miliony, co musi go mocno boleć (tym bardziej, że jest Żydem, a oni zwyczajowo nie należą do osób rozrzutnych). Taki chatbot mógłby być idealnym „wirtualnym hejtstopem”. Nie wymagałby płacenia mu pensji ani wynajmowania lokalu, więc praktycznie darmowy w utrzymaniu (koszty to tylko prąd, łącze i komputer). Chatbot z Microsoftu w ciągu jednego dnia znalazł mnóstwo rasistów, nazistów, czcicieli Hitlera i przykładów na tzw. kłamstwo oświęcimskie, a więc jest dużo skuteczniejszy od klasycznego hejtstopu (który wynajduje same naciągane przypadki i co chwilę musi robić przerwę na pączka i kebab). Taki chatbot to byłaby całkowita rewolucja w branży hejtstopu i rzeka złota dla Sorosa.

Skoro jednak Soros nie przejął od Microsoftu tej kury znoszącej złote jaja i nie wywalił na zbity pysk połowy swoich działaczy od wyszukiwania hejtu – wniosek jest oczywisty. Nie było żadnego hitlerowskiego chatbota, a cała sprawa to jedna wielka bujda i hucpa dla idiotów. Kodu źródłowego, ani żadnych szczegółów technicznych – Microsoft nie ujawnił (czemu mnie to nie dziwi?). Aby dodać sprawie wiarygodności – profilowi na Twitterze uosobiono tożsamość 19-letniej, niebrzydkiej dziewczyny. Jasna sprawa, gdyby był to 60 letni facet z brodą i okularach przeciwsłonecznych – jeszcze mniej ludzi by dało się zrobić konia.

Oczywiście chatboty w dzisiejszych czasach istnieją i są faktem, ale akurat ten przypadek jest naciągnięty jak plandeka na Tarpanie. Albo w ogóle nie istniał i konto na Twitterze obsługiwali prawdziwi ludzie (np. Żydzi), albo programista tego chatbota ukierunkował go na uczenie się wyłącznie się kontrowersyjnych i zakazanych treści. Trzecia możliwość była taka, że internauci specjalnie strollowali tego bota, z ciekawości pisząc mu w kółko o Hitlerze, żeby zobaczyć co odpowie. Jednakże tego można było się z góry spodziewać, a kontrowersyjne odpowiedzi chatbota można było bardzo łatwo stonować, albo całkiem wyeliminować – wystarczyłoby zaaplikować botowi „czarną listę” słów, których nie mógłby używać (Hitler, Breivik, przekleństwa, sprośne słówka czy wszystkie odmiany słowa Żyd) i byłoby po sprawie. Skrypt zostałby więc zmuszony do szukania innej, „normalnej” wersji wypowiedzi. Nie zrobiono tego – a byłoby to piekielnie łatwe, zwłaszcza dla Microsoftu, który dysponuje potężnym zapleczem programistycznym. Według mnie nastawienie Microsoftu było na konkretny efekt, inaczej mówiąc – cała sprawa stworzona była pod konkretne tezy. Jakie to tezy? Napiszę je w punktach:

- Chatbot został fanem Donalda Trumpa (a więc w podtekście „oho, spójrzcie tylko – nazista popiera Trumpa!” – doskonale znamy zresztą tę retorykę w Polsce, gdzie każdy nie-lewak jest automatycznie nazistą, a Hitleroza i Prawo Godwina stosowane jest nagminnie od wielu lat)

- Chatbot został rasistą, ale oczywiście nie anty-białym (mimo, że biali to tylko jakieś 20% użytkowników internetu) – więc w podtekście „murzyni i Meksykanie są fajni i tolerancyjni, ale źli biali znowu wszystko muszą zepsuć swoim rasizmem”. Czyli klasyczne sprowadzenie zjawiska rasizmu wyłącznie do wąskiej, politycznie poprawnej, „sorosowej” i „hejtstopowej” odmiany.

- Chatbot shejtował feministki

- Chatbot chciał budowy muru na granicy USA-Meksyk (swoją drogą tam teraz jest już potężne ogrodzenie, nie to co w Europie)

- Chatbot stwierdził, że Holokaustu nie było

- Chatbot rozsyłał zdjęcia Breivika i chwalił jego działania

Czyli ten chatbot to typowy biały nazista. Dziwne, że nie nauczył się niczego z rozmów z muzułmanami czy murzynami, których jest na świecie kilkukrotnie więcej, niż białych. Czyli wychodzi na to, że biali ludzie są dużo bardziej wpływowi i mają dużo większy posłuch, nawet jeśli chodzi o sztuczną inteligencję… Microsoft po niecałej dobie wyłączył cały projekt do odwołania (a podejrzewam, że na zawsze, żeby się dalej nie kompromitować), mimo, że modyfikacja byłaby stosunkowo łatwa. Z własnego doświadczenia wiem, że gdy w internecie występuje słowo „Hitler” czy „nazizm” – w 99% przypadków jest ono używane w sensie pejoratywnym (przeważnie chodzi o „erystyczne” łączenie przeciwnika w dyskusji z tymi negatywnymi zjawiskami, z powodu braku lepszych argumentów). A tu ni stąd, ni zowąd – chatbot uczy się tych rzeczy jako zjawiska pozytywne i godne do naśladowania… Sprawa cuchnie na kilometr i według mnie jest to z góry zaplanowana ściema, aby zdyskredytować politycznie-niepoprawne postawy osób o białej skórze.

PS: Mniej więcej w tym samym czasie jeden Brytyjczyk napisał na Twitterze: „Spotkałem wczoraj muzułmankę w Croydon. Poprosiłem ją o wyjaśnienie Brukseli. – To nie ma nic wspólnego ze mną – powiedziała. Czcze gadanie”. Efekt? gość został aresztowany, a o tym „rasistowskim” wpisie rozpisano się na całym świecie (także w niezawodnej w tym względzie GW, która oczywiście zablokowała komentarze). Skoro taki przypadek zasłużył na areszt, to dlaczego całkowicie zignorowano temat ścigania osób, które nauczyły nazizmu chatbota z Microsoftu? To kolejny dowód na to, że cała historia została sfabrykowana.

PS2: Sztuczna inteligencja jest w czarnej dupie i jej rozwój w ostatnich latach praktycznie wyhamował – coś jak kosmonautyka. Szczytem możliwości AI jest wygrana w szachy, ale w bardziej skomplikowane gry typu Starcraft czy Civilization komputer nie ma szans z człowiekiem, chyba, że będzie oszukiwał. Dla ludzkości to dobrze – podstawowa zasada NWO to kontrola ludzkości przez bezwzględne roboty (coś jak w filmie 'Elizjum’). Obecnie jednak wszystkie roboty są głupie jak but i nie można im powierzyć żadnej kreatywnej i twórczej odpowiedzialności.

RacimiR, 25.03.2016

Fajnie że ostatnio tyle publikujesz, stałeś się dla mnie głównym serwisem informacyjnym teraz 😀

Tak trzymaj i powodzenia 🙂

Akcje 4chan są dość znane i nie dziwi mnie, że tym razem strollowali Microsofta. Jednak możliwe jest, że celowo wgrano jej take a nie inne odpowiedzi, żeby jak zwykle zrzucić winę na nas (przecież od dawna wiadomo, że biały to największy rasista i fan Hitlera) za „naukę” bota. Tu wklejam link do screanów z 4chan: http://boards.4chan.org/pol/thread/68537741/tay-new-ai-from-microsoft

od RacimiR: Bardzo ciekawe niektóre konwersacje. Np. TAKA – widać, że bot raz jest fanem Trumpa, a innym razem go krytykuje (swoją drogą braku energii raczej nie można Trumpowi zarzucić). Mówiąc że wygra czarny (kiedy żaden nie kandyduje) to z kolei rasizm w najczystszej postaci 🙂